Ошибки Чат ГПТ: неточности нейросети и как избегать

Стремительное внедрение ChatGPT в повседневную жизнь породило огромное количество завышенных ожиданий. Многие пользователи воспринимают эту языковую модель как всезнающего оракула, который обладает абсолютной истиной и способен безошибочно решить любую задачу. Однако на практике даже такой продвинутый искусственный интеллект регулярно совершает досадные промахи, выдавая откровенную выдумку за научно доказанный факт. Слепое доверие к машинному разуму может привести к серьезным проблемам: от проваленного студенческого экзамена до многомиллионных судебных исков из-за неверной юридической консультации. Чтобы безопасно и продуктивно работать с нейросетью, необходимо понимать ее внутреннюю логику, знать слабые места и уметь грамотно фильтровать получаемую информацию.

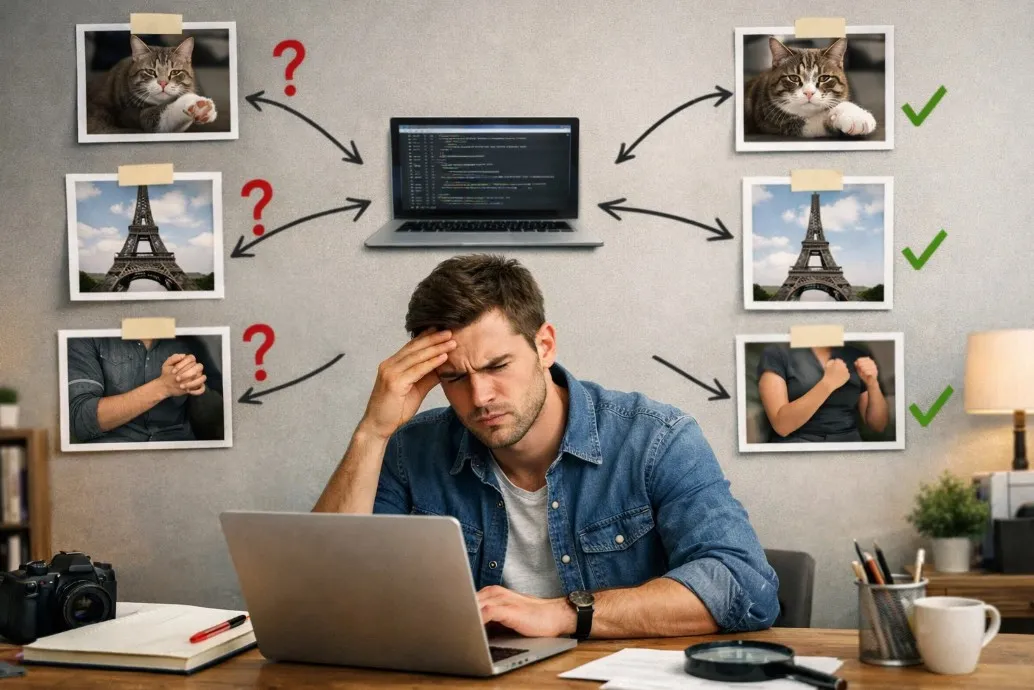

Природа подобных сбоев кроется в самой архитектуре алгоритма. Модель не ищет информацию в достоверной базе данных подобно классическому поисковику. Она генерирует текст слово за словом, математически предсказывая наиболее вероятное продолжение фразы на основе огромных массивов текстов, на которых была обучена. Именно поэтому, когда системе не хватает реальных фактов для ответа на сложный вопрос, она начинает их конструировать самостоятельно, стремясь дать максимально убедительный и связный ответ. Подобное явление в профессиональной среде получило название машинных галлюцинаций.

Основные ограничения: с чем не справляется Чат ГПТ

Главная ловушка при взаимодействии с генеративными моделями заключается в их невероятной самоуверенности. Нейросеть крайне редко признается, что чего-то не знает, если ей заранее не задать строгие рамки. Она может с идеальной орфографией и профессиональной терминологией доказывать существование вымышленных исторических событий или несуществующих законов физики.

Существует ряд специфических сценариев, при которых система с высокой долей вероятности выдаст некорректный или полностью вымышленный результат:

- Сложные математические вычисления: алгоритм плохо справляется с многоступенчатыми уравнениями, так как просто предсказывает следующий символ текста, а не производит арифметические действия по строгим правилам.

- Анализ актуальных событий: база знаний конкретной версии всегда ограничена определенным временным периодом, из-за чего модель может не знать о свежих политических решениях или вчерашних технологических релизах без прямого подключения к интернету.

- Понимание глубокого контекста: при очень длительной беседе искусственный интеллект часто теряет нить рассуждений и забывает важные детали, которые обсуждались в начале диалога, что приводит к логическим противоречиям в финальных выводах.

- Отсутствие реального опыта: машина никогда не пробовала еду на вкус и не ощущала человеческих эмоций, поэтому ответы по тонкой психологии или решению межличностных конфликтов часто оказываются слишком шаблонными.

Осознание этих базовых слабостей помогает выстраивать правильные ожидания. Пользователю необходимо понимать, что перед ним находится невероятно мощный лингвистический инструмент, а не безошибочный калькулятор или поисковая машина реального времени.

Как правильно работать с нейросетью

Чтобы минимизировать риск получения недостоверной информации и эффективно бороться с галлюцинациями, критически важно выстроить грамотный процесс взаимодействия с искусственным интеллектом в удобной среде. Сегодня мощный и быстрый чат гпт доступен каждому без сложных настроек, обходных путей и иностранных номеров. Перейдя по ссылке www.aijora.ru, вы получаете полнофункциональное рабочее пространство, где передовые текстовые алгоритмы собраны в интуитивно понятном интерфейсе платформы Aijora.

Процесс работы здесь выстроен максимально логично и направлен на то, чтобы вы могли легко контролировать точность выдаваемых данных. Сначала вы открываете новое диалоговое окно и задаете базовый контекст вашей задачи. Если вы замечаете, что нейросеть начинает уходить от темы или придумывать факты, интерфейс Aijora позволяет моментально остановить генерацию, отредактировать свой прошлый запрос и запустить процесс заново с более жесткими ограничениями. Вы можете использовать удобную историю чатов, чтобы возвращаться к удачным диалогам и просить алгоритм перепроверить самого себя. Работая на этой платформе, вы избавляетесь от технических зависаний и можете сфокусироваться исключительно на оттачивании своих промптов, шаг за шагом улучшая фактологическую точность получаемых текстов.

Уровень доверия: специфика применения в разных профессиях

Каждая профессиональная отрасль предъявляет собственные строгие требования к достоверности используемой информации. Если в одних нишах небольшая фантазия алгоритма может стать отличным источником креативного вдохновения, то в других она способна спровоцировать серьезный системный кризис и нанести непоправимый вред репутации.

Для наглядного понимания степени ответственности мы сопоставили различные сферы применения нейросети и потенциальные угрозы от неконтролируемого использования генеративных текстов.

| Сфера применения | Уровень риска | Склонность к выдумкам | Методы контроля |

|---|---|---|---|

| Креативный копирайтинг | Низкий риск | Минимальная вероятность | Обычная стилистическая вычитка текста |

| Разработка программного кода | Средний риск | Умеренная вероятность | Обязательный запуск скриптов в компиляторе |

| Юридические консультации | Критический риск | Высокая вероятность | Сверка ссылок с официальными базами законов |

| Медицинские советы | Недопустимый риск | Крайне высокая вероятность | Обязательная консультация с реальным врачом |

Представленные данные подтверждают золотое правило взаимодействия с цифровыми технологиями. Такая система выступает великолепным вспомогательным инструментом для ускорения интеллектуальной рутины, но категорически не способна заменить экспертный человеческий контроль и многолетний профессиональный опыт.

Стратегии безопасности: как получать достоверные ответы

Существуют проверенные методики формулирования запросов, которые заставляют языковую модель фокусироваться на реальных фактах и отключать ненужную креативность. Опытные специалисты применяют в работе несколько базовых правил, позволяющих извлекать из нейросети только точную информацию.

Установка строгих границ является первоочередной задачей при составлении любого запроса:

- Жесткие рамки ответов: всегда добавляйте в запрос четкое указание, что если модель не знает правильного ответа, она должна прямо об этом сообщить, а не пытаться придумать недостающие детали.

- Запрос ссылок на источники: требуйте подкреплять статистические данные, исторические даты и научные термины названиями реальных исследований, чтобы их можно было перепроверить.

- Пошаговое решение проблемы: при решении запутанных логических задач просите систему рассуждать последовательно, объясняя каждое промежуточное действие, что заметно снижает риск внезапного сбоя.

- Разделение глобальной задачи: не пытайтесь сгенерировать огромный аналитический отчет одним сообщением. Лучше поручить модели сначала собрать сухие факты, затем составить подробный план, и только потом писать итоговый материал.

Использование этих простых коммуникативных тактик радикально снижает процент фактических ошибок в итоговом тексте. Система начинает воспринимать команды как строгие должностные инструкции. Эволюция ChatGPT продолжается, и с каждым обновлением алгоритмы становятся точнее. Однако по-настоящему грамотный подход заключается в том, чтобы всегда относиться к такой технологии как к талантливому, но весьма самоуверенному ассистенту. Используйте подобные платформы для быстрого сбора фактуры, преодоления страха чистого листа и автоматизации рутинных задач, оставляя за собой роль главного редактора и финального критика. Именно такой осознанный симбиоз позволяет достигать выдающихся результатов без риска стать жертвой машинной дезинформации.